空地智能无人系统环境感知挑战赛

1. 竞赛目的与意义

空地智能无人系统环境感知挑战赛(Aerial-Ground Intelligent Unmanned System Environment Perception Challenge, AGEP)依托第五届中国模式识别与计算机视觉大会(The 5th Chinese Conference on Pattern Recognition and Computer Vision, PRCV 2022)将于8月1日正式开赛。VisDrone团队自2018年以来在ECCV和ICCV顶级会议上已连续成功举办了四届挑战赛,该挑战赛包含多个赛道,用于无人机平台上的检测、计数等各种核心视觉任务。

历届挑战赛吸引了清华大学、北京大学、中科院、腾讯、深兰科技、CMU和悉尼科技大学等国内外知名高校及机构的许多学生和相关研究人员参加。到目前为止,已经有38篇会议论文发表在VisDrone Workshop,众多论文中提出的无人机检测、跟踪和人群计数的新方法,使视觉与无人机相遇,并将无人机带入大众的生活。今年,港科大的RAM-LAB团队将多传感器融合SLAM带入到挑战赛中,进一步推动了智能无人系统的蓬勃发展。

2. 竞赛组织方

咨询委员会:胡清华、韩军伟、刘明

组委会:朱鹏飞、何志坚、张鼎文、王旗龙、王魯佳、焦健浩、王煜、曹兵、张敬林

组织单位:天津大学、香港科技大学、西北工业大学、山东大学

联系邮箱:tju.drone.vision@gmail.com

竞赛网址:http://aiskyeye.com/

3. 竞赛者要求

按自愿报名的原则,参赛团队和成员的组成可以为:

1. 各培养单位正式注册教师、在读研究生以及博士生。

2. 国内各研究团体、企事业单位。

4. 参赛方式

以个人或团队方式均可通过网站注册报名参赛,每名参赛选手只能参加1个参赛队。每个参赛队伍在竞赛截止时间之前最多可更新10次结果,截止时间之后不能再更新结果。

参赛队优先通过网站中各赛道的微信群二维码加入官方群,并填写腾讯文档申请网站账号评测次数。无法入群的参赛人员通过官方邮箱tju.drone.vision@gmail.com申请。需要在邮件中注明队长的账户名、真实姓名、所属机构、所属国家、邮箱地址和全部队伍成员的真实姓名与所属机构。组织方收到邮件并与报名者确认后,报名成功。

目标检测和双光人群计数赛道报名截止日期为:2022年9月15日。Visual SLAM赛道报名截止日期延长为:2022年9月30日。

5. 组织方式

拟采用的组织方式为组织方为参赛选手提供完整的技术支持,协助开发者跑通流程,按规定格式输出算法模型结果。提交结果文件后,组织方会在硬件测试环境和测试样本数据上进行测试,通过运行测试程序验证结果文件,从而评估模型的性能,评出名次。本次竞赛设置无人机视角下的目标检测、双光人群计数和地面上机器人的Visual SLAM任务,共三个赛道,参赛选手可以根据自己情况自由进行赛道选取。

赛程如下:

时间 | 具体安排 |

8月1日 | 组委会在网站公布比赛任务、参赛办法和评比方式。 |

8月1日-9月15日 | 比赛开始,组委会发布比赛训练集和评测格式。各参赛队在规定时间内完成比赛任务,将结果按照规定的格式上传至网站指定位置。每个参赛队只能提交十次结果参与评测。网站根据评测方法,验证各队程序执行结果。网站实时对结果进行评测,更新各队名次。 |

9月15日 | 目标检测、双光人群计数赛道比赛结束,关闭评测。 |

9月30日 | Visual SLAM赛道比赛结束,关闭评测。 |

12月23日-12月26日 | 在第五届中国模式识别与计算机视觉大会PRCV2022竞赛单元介绍获奖单位比赛方法,为获奖团队颁奖。 |

6. 赛事数据集的使用

本次比赛的数据来源于组织方发布的数据集,数据集具有如下特点:

1. 无人机目标检测数据集

图像大小:图像分辨率为960*540

测试集:专家选择3190张JPG图像,数据格式为:TXT

验证集:专家选择548张JPG图像,数据格式为:TXT;

训练集:由专家手工标记的JPG图像,共6471张,数据格式为:TXT;(可以补充公开的其他数据集)

2. 无人机双光人群计数数据集

图像大小:图像分辨率为640*512;

测试集:由专家手工标记的人群头部点信息,共912对图像。

训练集:由专家手工标记的人群头部点信息,共1807对RGBT图像,标签存储格式为XML文件,包括图像大小、图像名称、人物标注坐标x,y;(可以补充公开的其他数据集)

3. 多传感器融合Visual SLAM数据集

数据序列:

包含由手持、机器狗和Apollo小车三种平台采集的室内外8种场景17个多传感器数据序列。数据格式为:rosbag;

传感器配置:

双目相机:

型号: FILR BFS-U3-31S4C

分辨率: 1024 × 768, 全局快门@20Hz

FOV: 垂直方向66.5度, 水平方向82.9度.

ROS话题: /stereo/frame (left, right)/image raw

双目事件相机:

型号:DAVIS346

分辨率: 346 × 240;

FOV: 垂直67度, 水平方向83度.

IMU: MPU6150@1000Hz, 6轴MEMS

Event ROS话题: /stereo/davis (left, right)/events

Image ROS话题: /stereo/davis (left, right)/image raw

IMU ROS话题: /stereo/davis (left, right)/imu

惯性导航

STIM300@200Hz, 6轴MEMS

Bias Instability 0.3度/小时

ROS topic: /stim300/imu/data raw

测试集:

由LIO算法构建的两个小型场景的作为参考轨迹,数据格式为:TXT。

7. 任务设置

赛道一:无人机视角下的目标检测

本赛道提供无人机视角下的目标检测数据集,如图所示。参赛选手允许补充额外的公开训练集。参赛选手通过训练样本对目标检测模型进行建模,然后对测试样本3190张图像中人、车等多类目标进行识别检测。

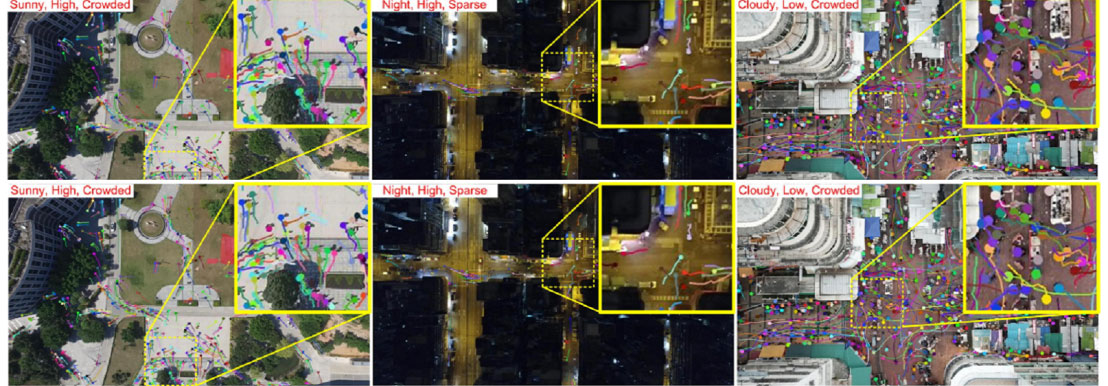

赛道二:无人机视角下的双光人群计数

本赛道提供无人机视角下的双光人群计数数据集,如图所示。参赛选手允许补充额外的公开训练集。参赛选手对人群计数算法进行建模,在举办方提供的成对RGB-T训练数据集上进行训练,在测试样本中进行测试得到最优模型并提交,提交的模型通过测试数据集,进行性能评价。

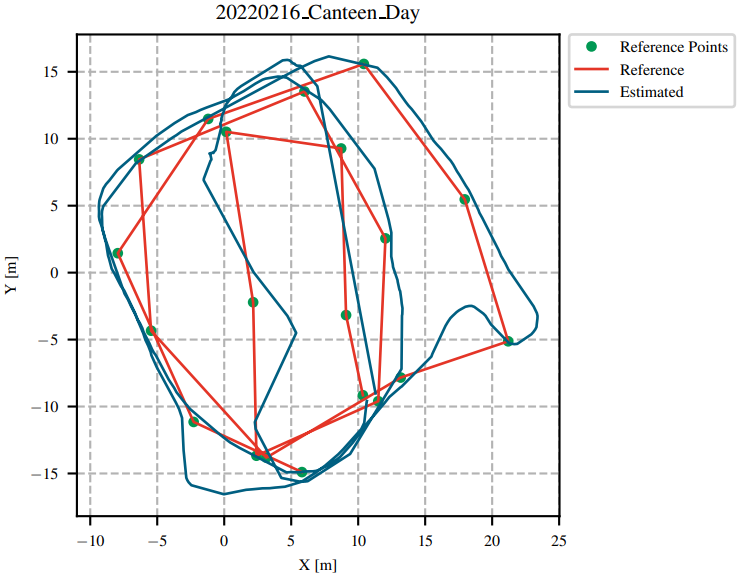

赛道三:多传感器融合Visual SLAM

本赛道提供多传感器融合Visual SLAM数据集,旨在融合数据集中的视觉图像(包括传统帧相机和事件相机)、IMU测量以及GPS信息来估计机器人的六自由度位姿。参赛选手通过提供的多传感器的数据序列构建VIO算法,生成相应数据序列的定位轨迹,如图所示。

8. 性能评价方法

赛道一:无人机视角下的目标检测

针对比赛任务中目标检测的要求,在给定的测试集中对人、车等目标进行识别检测,同时以TXT文件输出结果文件。

性能评价分为两部分:

1.平均精确率(AP, AP50,AP75):TP/(TP+FP)即模型预测目标中预测正确的比例,数值指的是IOU(交并比);

2.平均召回率(AR1, AR10, AR100, AR500):TP/(TP+FN)即所有真实目标中,模型预测正确的目标比例。

赛道二:无人机视角下的双光人群计数

在给定的无人机视角下的输入图片,参赛者使用人群计数算法计算密度图估计图片中的人数,同时以TXT文件形式输出。算法的性能通过MAE、MSE数值进行评判:

MAE:算法估计人数与标签人数的绝对值平均误差;

MSE:算法估计人数与标签人数的均方差。

赛道三:多传感器融合Visual SLAM

针对比赛任务中估计定位姿态的要求,选手应在给定的数据序列中构建VIO算法,并生成以IMU坐标系为基准的定位轨迹,同时以TXT文件输出包含姿态时间戳和对应的六自由度姿态估计结果。

我们将根据提交的轨迹的完整性、频率以及位置精度(ATE)进行排名。分数基于轨迹上各个点的 ATE。误差小于距离阈值的点将被添加到您的最终分数中。该评估方案的是启发于HILTI SLAM Challenge。用于轨迹精度评估的脚本请参考这里 http://aiskyeye.com/visual-slam-guidelines。

请注意!所有的输出轨迹应转换为body_imu坐标系(即IMU传感器所在坐标系上),我们将使用刚性变换将提交的每一个数据序列轨迹与密集的真值点对齐,然后计算一组离散真值点的绝对位置误差ATE。根据误差大小,在每个真值点的上评估结果都会加到总分数上。

我们还将每个序列的总分数进行归一化处理,以便每个序列满分是100分(所有评估点的误差均小于或等于5厘米),17个数据序列满分为1700分。详细的评分标准如下:

评估点的绝对位置误差 | 得分 |

小于或等于5厘米 | 10 |

小于或等于30厘米 | 6 |

小于或等于50厘米 | 3 |

小于或等于100厘米 | 1 |

大于100厘米 | 0 |

9. 比赛任务的提交格式

赛道一:无人机视角下的目标检测

对测试集每幅图,对图像中的人、公交车、小轿车、自行车、卡车、摩托车、三轮车等对象进行目标检测,同时提交TXT文件,文件中每一行是包含图像中的一个对象实例,示例如下:

<左上角x>,<左上角y>,<宽度>,<高度>,<得分>,<类别>,<截断>,<遮挡>

具体解释:

<左上角x>:预测边界框的左上角的x坐标;

<左上角y>:预测对象边界框的左上角的y坐标;

<宽度>:预测对象包围框的宽度(以像素为单位);

<高度>:预测对象包围框的像素高度;

<得分>:检测结果文件中的分数表明了包围一个对象实例的预测边界框的置信度。“GROUNDTRUTH”文件中的分数设置为1或0。1表示计算时考虑包围盒,0表示忽略包围盒;

<类别>:对象类别表示标注对象的类型,(即忽略区域(0),行人(1),人(2),自行车(3),轿车(4),货车(5),卡车(6),三轮车(7),遮阳三轮车(8),公共汽车(9),马达(10),其他(11)));

<截断>:检测结果文件中的分数应该设置为常数-1。GROUNDTRUTH文件中的分数表示物体部分出现在帧外的程度(即,没有截断= 0(截断率0%),部分截断= 1(截断率1%~50%));

<遮挡>:检测结果文件中的分数应该设置为常数-1。GROUNDTRUTH文件中的分数表示物体被遮挡的比例(即没有遮挡=0(遮挡率0%),部分遮挡=1(遮挡率1%~50%),重度遮挡= 2(遮挡率50%~100%))。

赛道二:无人机视角下的双光人群计数

对测试集每张图像进行人群计数,同时提交TXT文件,文件中每一行为:

<帧数下标>,<人数>

具体解释:

帧数下标:图像在视频中的第几帧(一般为图像名);

人数:图像中人头数;

例如:000686,94.1234123。

赛道三:多传感器融合Visual SLAM

对于每一个数据序列,通过VSLAM或VIO算法生成的定位轨迹文件,格式是TXT文件,文件命名和数据序列的rosbag文件命名一致。所有的轨迹文件需要压缩成一个.zip 文件用于上传,其中根目录有一个traj文件夹包含所有轨迹文件。其内容如下:

--traj/

-- --20220215_canteen_night.txt

-- --20220215_garden_night.txt

-- --20220219_MCR_slow_00.txt

-- --20220226_campus_road_day.txt

-- --....

对每一个数据序列的TXT文件的每一行轨迹记录,采用TUM格式,详细格式示例如下:

timestamp x y z qx qy qz qw

例如:

1644928761.036623716 0.0 0.0 0.0 0.0 0.0 0.0 1.0

具体解释:

timestamp:每一帧点云的时间戳,至少精确到小数点后5位以保证与真值时间做正确的对应;

x:预测的IMU系下的位置坐标x;

y:预测的IMU系下的位置坐标y;

z:预测的IMU系下的位置坐标z;

qx:预测的IMU系下的姿态四元数qx;

qy:预测的IMU系下的姿态四元数qy;

qz:预测的IMU系下的姿态四元数qz;

qw:预测的IMU系下的姿态四元数qw;

10. 奖项设置

每个赛道设一等奖1名(奖金5000元人民币),二等奖1名(奖金3000元人民币),三等奖1名(奖金2000元人民币)。

各赛道排名前三的参赛队伍均可获得由组委会颁发的获奖证书。

除此之外,我们设立由组委会颁发的“最佳开源奖”获奖证书来鼓励各位参赛者提交源码。

11. 知识产权及其他注意事项

1. 各参赛队在赛前需签订数据使用协议,承诺本竞赛提供的数据集仅能用于本竞赛,不用于除本竞赛外的任何其他用途,并承诺数据用后即刻删除,不可扩散,主办方保留追究法律责任的权利。

2. 各参赛队需要承诺本队提交的结果可重复,参赛队所有的方案、算法以及相关的知识产权均属于参赛队伍所有,组织方承诺履行保密义务,并不用于除本比赛外的任何其他用途。

3. 参赛队伍应保证所提供的方案、算法属于自有知识产权。组织方对参赛队伍因使用本队提供/完成的算法和结果而产生的任何实际侵权或者被任何第三方指控侵权概不负责。一旦上述情况和事件发生参赛队伍必须承担一切相关法律责任和经济赔偿责任并保护组织方免于承担该等责任。

4. 该项竞赛为公益性赛事,全程不收取参赛队伍任何费用。

5. 竞赛期间,组委会坚持公开、公平、公正的原则。参赛结果评比由统一测试代码完成,如参赛队伍对公布结果有异议,可申请成绩复核。